【CWM-179】浴びた女も感激する一撃!!大量顔射!!! Part3 不花一分钱!GPT-4o微调限时免费怒放,逐日附赠百万考研token

一醒觉来【CWM-179】浴びた女も感激する一撃!!大量顔射!!! Part3,OpenAI又上新功能了:

GPT-4o雅致上线微调功能。

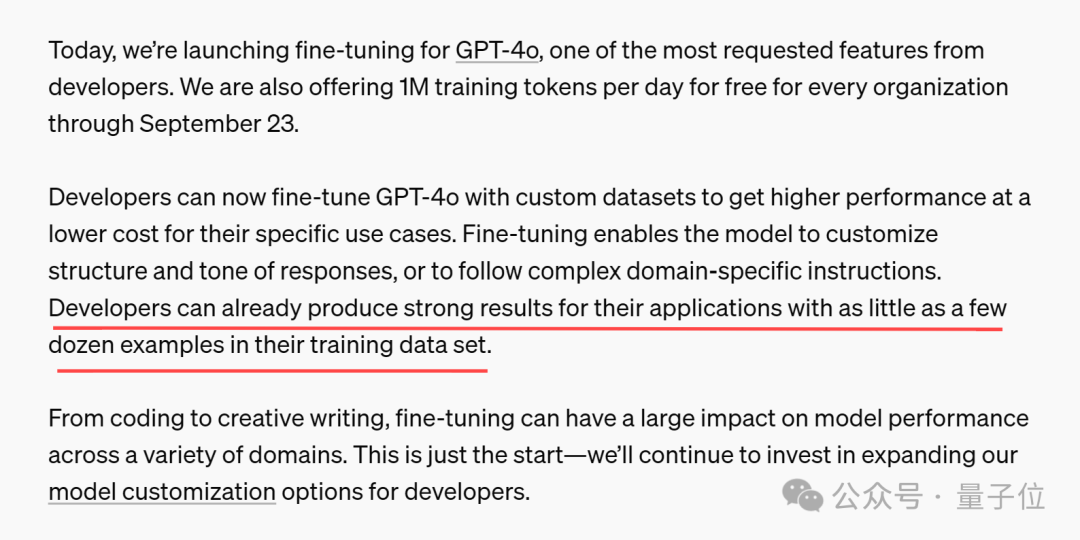

何况官方还附赠一波福利:每个组织每天王人能免费赢得100万个考研token,用到9月23日。

也等于说,树立东谈主员当前不错使用自界说数据集微调GPT-4o,从而低资本构建我方的诈欺设施。

要知谈,OpenAI在公告中裸露了:

GPT-4o微调考研资本为每100万token 25 好意思元(意味着每天王人能省俭25好意思元)

收到邮件的树立者们容或地驱驰相告,这样大的羊毛一定要迅速薅。

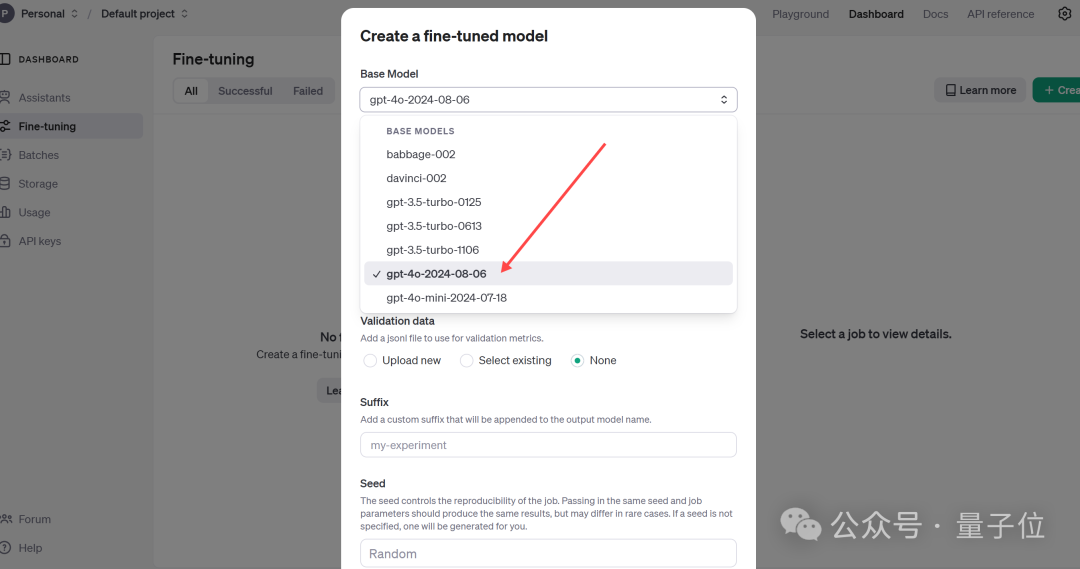

使用花样也很通俗,平直考查微调姿首盘,点击”create”,然后从基本模子下拉列表中选择gpt-4o-2024-08-06。

对了,OpenAI还提到,只需考研数据连合的几十个示例就不错产生清雅成果。

还晒出了告捷案例

音问公布后,一众网友撺拳拢袖,暗示很想知谈模子微调后的履行成果。

OpenAI官方早有准备,随公告一同发布了合营伙伴微调GPT-4o的履行案例。

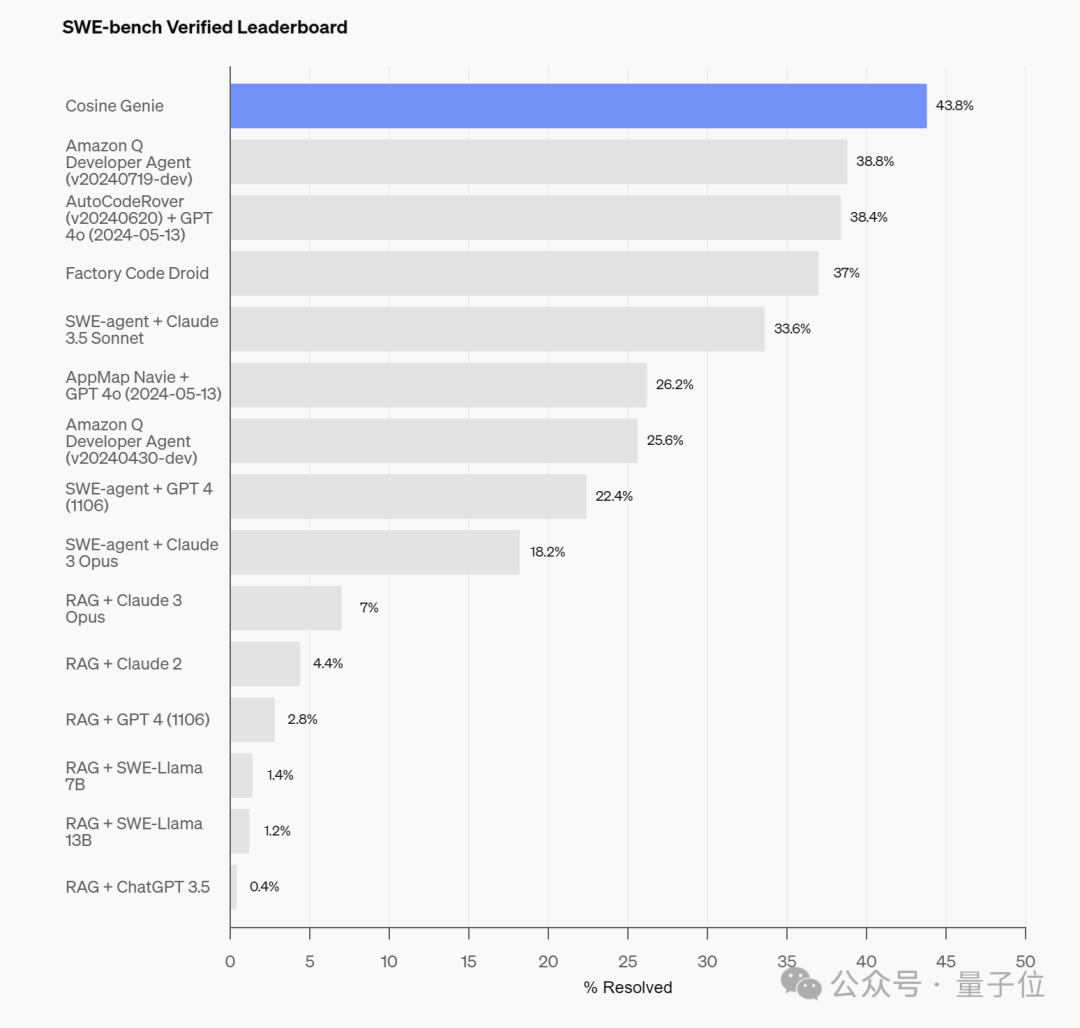

率先是一款代码助手Genie,来自AI初创公司Cosine,专为协助软件树立东谈主员而规画。

据Cosine官方先容【CWM-179】浴びた女も感激する一撃!!大量顔射!!! Part3,Genie的树立过程摄取了一种荒谬经过,使用数十亿个高质地数据对非公开的GPT-4o变体进行了考研和微调。

这些数据包括21%的JavaScript和Python、14%的TypeScript和TSX,以及3%的其他说话(包括Java、C++和Ruby)。

经过微调,Genie在上周二OpenAI全新发布的代码材干基准测试SWE-Bench Verified上,取得了43.8%的SOTA分数。

与此同期,Genie还在SWE-Bench Full上的SOTA分数达到了30.08%,破了之前19.27%的SOTA记载。

相较之下,Cognition的Devin在SWE-Bench的部分测试中为13.8%。

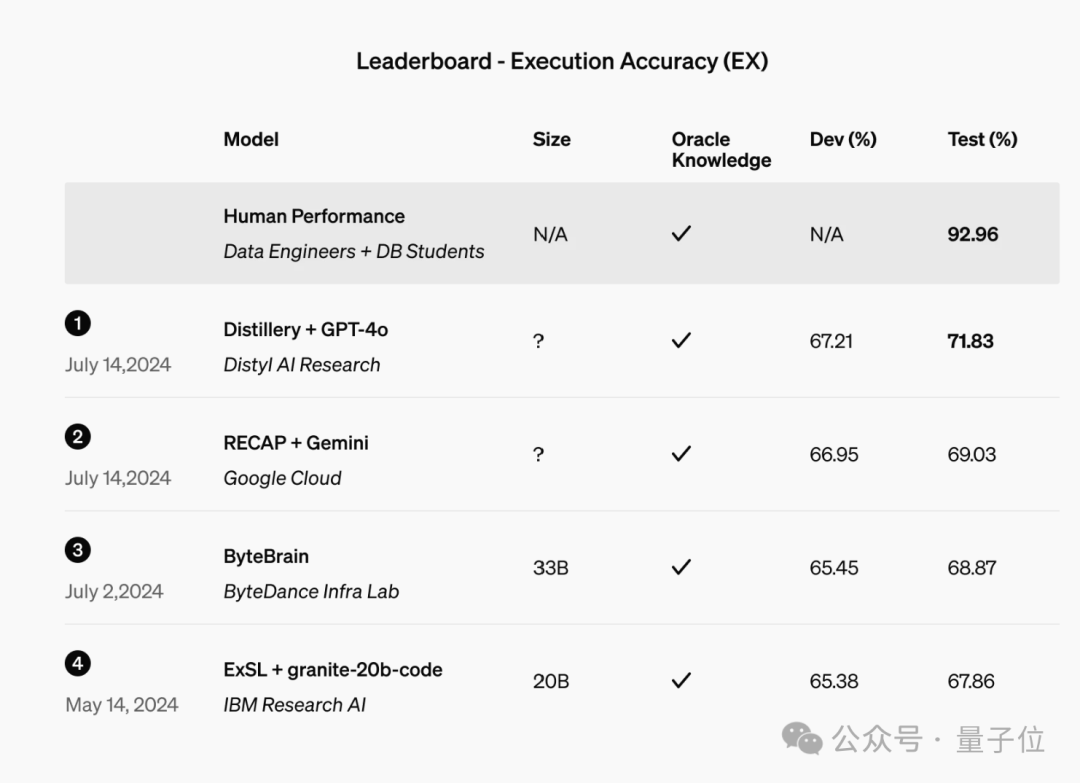

另一个案例来自Distyl,这是一家为资产500强企业提供AI处治决策的公司,最近在超越的文本到SQL基准测试BIRD-SQL中排名第一。

经过微调,其模子在排名榜上竣事了71.83%的施行准确率,奇米影视网址是多少并在查询重构、意图分类、想维链和自我雠校等任务中发扬出色,尤其是在SQL生成方面发扬尤为凸起。

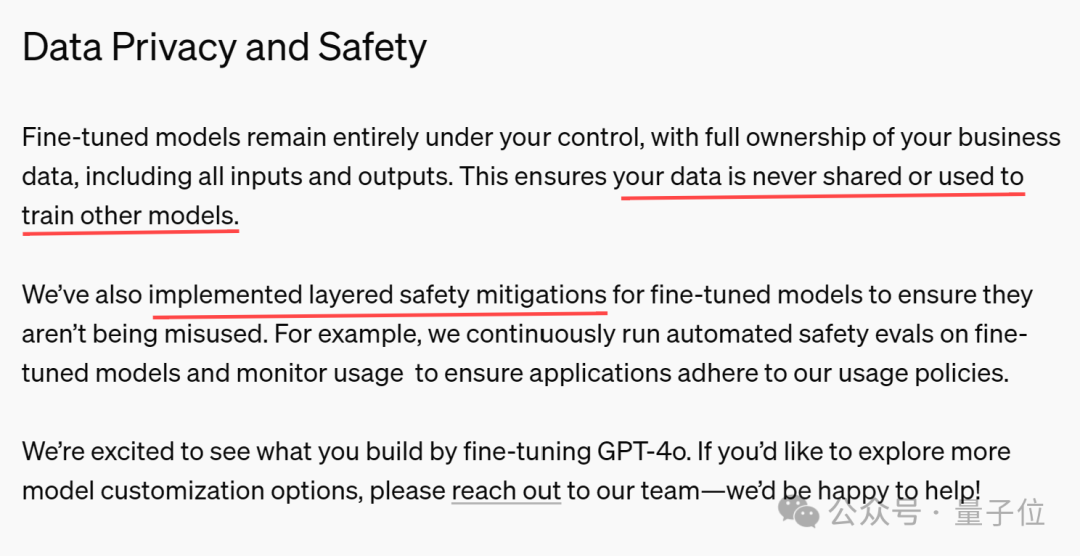

除了提供案例,OpenAI还在公告中成心强调了数据隐秘和安全问题,追思下来等于:

树立者的业务数据(包括输入和输出)不会被分享或用于考研其他模子。

针对微调模子实施了分层安全缓解要领,举例握住对微调模子入手自动安全评估并监控使用情况。

网友:微调比不上辅导词缓存

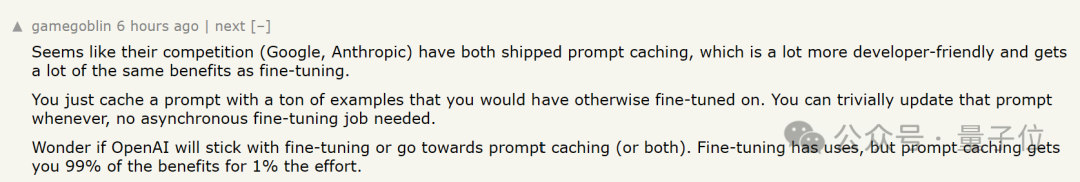

一派吵杂之际,有网友以为微调仍然比不上辅导词缓存。

微调很酷,但它仍然不如辅导词缓存……

之前量子位也先容过,辅导词缓存的作用,等于一次给模子发送大王人prompt,然后让它记取这些内容,并在后续恳求中平直复用,幸免反复输入。

本年5月,谷歌的Gemini就也曾救济了辅导词缓存,Claude也在上周上新了这项功能。

由于不需要反复输入重迭的剧本,辅导词缓存具有速率更快、资本更低这两大上风。

有网友以为,辅导词缓存功能对树立者更友好(无需异步微调),且险些不错赢得与微调调换的克己。

辅导词缓存不错让您付出1%的悉力赢得99%的克己。

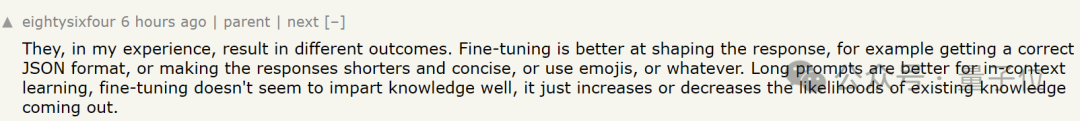

不外也有东谈主给微调打call,以为微调在塑回击应方面更灵验。举例确保JSON体式正确、反应更简约或使用样式标识等。

眼见OpenAI的竞争敌手们接踵用上了辅导词缓存,还有东谈主趣味了:

想知谈OpenAI是否会坚合手微调或转向辅导词缓存(或两者兼容并包)。

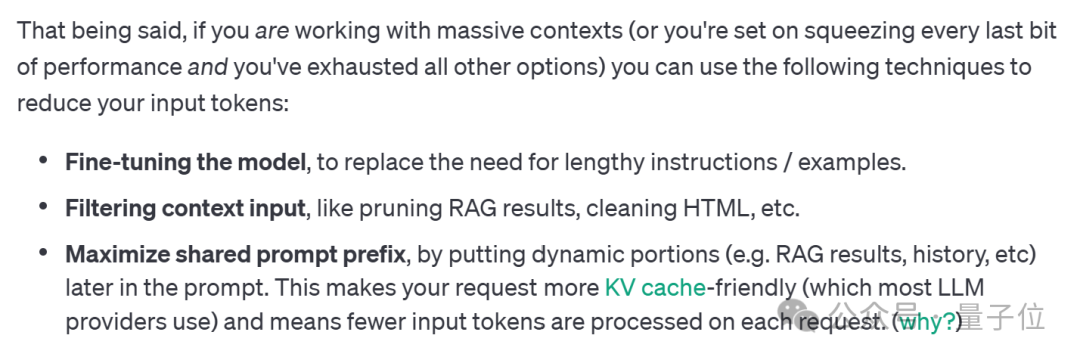

关于这个问题,有其他网友也嗅出了一些蛛丝马迹。

OpenAI在其延伸优化指南中提到了缓存技能。

咱们也第一时候找了下指南原文,其中在谈到如何减少输入token时提到:

通过在辅导中稍后遗弃动态部分(举例RAG为止、历史记录等),最大化分享辅导前缀。这使得您的恳求对KV缓存愈加友好,意味着每个恳求处理的输入token更少。

不外有网友以为,仅凭证这一段内容,无法平直推出OpenAI摄取了辅导词缓存技能。

BTY,抛开争议不谈,OpenAI的羊毛照旧得薅起来~

除了GPT-4o,还不错免费微调GPT-4o mini,9月23日之前OpenAI免费提供每天200万个考研token。